Robots.txt ಫೈಲ್ ಎಂದರೇನು? SEO ಗಾಗಿ ನೀವು ರೋಬೋಟ್ಸ್ ಫೈಲ್ ಅನ್ನು ಬರೆಯಲು, ಸಲ್ಲಿಸಲು ಮತ್ತು ಮರುಕ್ರಾಲ್ ಮಾಡಲು ಅಗತ್ಯವಿರುವ ಎಲ್ಲವೂ

ನಾವು ಸಮಗ್ರ ಲೇಖನವನ್ನು ಬರೆದಿದ್ದೇವೆ ಸರ್ಚ್ ಇಂಜಿನ್ಗಳು ನಿಮ್ಮ ವೆಬ್ಸೈಟ್ಗಳನ್ನು ಹೇಗೆ ಹುಡುಕುವುದು, ಕ್ರಾಲ್ ಮಾಡುವುದು ಮತ್ತು ಸೂಚಿಕೆ ಮಾಡುವುದು. ಆ ಪ್ರಕ್ರಿಯೆಯಲ್ಲಿ ಒಂದು ಮೂಲಭೂತ ಹೆಜ್ಜೆ robots.txt ಫೈಲ್, ನಿಮ್ಮ ಸೈಟ್ ಅನ್ನು ಕ್ರಾಲ್ ಮಾಡಲು ಹುಡುಕಾಟ ಎಂಜಿನ್ನ ಗೇಟ್ವೇ. ಹುಡುಕಾಟ ಎಂಜಿನ್ ಆಪ್ಟಿಮೈಸೇಶನ್ನಲ್ಲಿ robots.txt ಫೈಲ್ ಅನ್ನು ಸರಿಯಾಗಿ ನಿರ್ಮಿಸುವುದು ಹೇಗೆ ಎಂಬುದನ್ನು ಅರ್ಥಮಾಡಿಕೊಳ್ಳುವುದು ಅತ್ಯಗತ್ಯ (ಎಸ್ಇಒ).

ಸರ್ಚ್ ಇಂಜಿನ್ಗಳು ತಮ್ಮ ವೆಬ್ಸೈಟ್ಗಳೊಂದಿಗೆ ಹೇಗೆ ಸಂವಹನ ನಡೆಸುತ್ತವೆ ಎಂಬುದನ್ನು ನಿಯಂತ್ರಿಸಲು ವೆಬ್ಮಾಸ್ಟರ್ಗಳಿಗೆ ಈ ಸರಳ ಮತ್ತು ಶಕ್ತಿಯುತ ಸಾಧನವು ಸಹಾಯ ಮಾಡುತ್ತದೆ. ವೆಬ್ಸೈಟ್ನ ಪರಿಣಾಮಕಾರಿ ಸೂಚಿಕೆ ಮತ್ತು ಹುಡುಕಾಟ ಎಂಜಿನ್ ಫಲಿತಾಂಶಗಳಲ್ಲಿ ಅತ್ಯುತ್ತಮ ಗೋಚರತೆಯನ್ನು ಖಚಿತಪಡಿಸಿಕೊಳ್ಳಲು robots.txt ಫೈಲ್ ಅನ್ನು ಅರ್ಥಮಾಡಿಕೊಳ್ಳುವುದು ಮತ್ತು ಪರಿಣಾಮಕಾರಿಯಾಗಿ ಬಳಸಿಕೊಳ್ಳುವುದು ಅತ್ಯಗತ್ಯ.

Robots.txt ಫೈಲ್ ಎಂದರೇನು?

robots.txt ಫೈಲ್ ಎನ್ನುವುದು ವೆಬ್ಸೈಟ್ನ ಮೂಲ ಡೈರೆಕ್ಟರಿಯಲ್ಲಿರುವ ಪಠ್ಯ ಫೈಲ್ ಆಗಿದೆ. ಸೈಟ್ನ ಯಾವ ಭಾಗಗಳನ್ನು ಕ್ರಾಲ್ ಮಾಡಬೇಕು ಅಥವಾ ಕ್ರಾಲ್ ಮಾಡಬಾರದು ಮತ್ತು ಸೂಚ್ಯಂಕಗೊಳಿಸಬಾರದು ಎಂಬುದರ ಕುರಿತು ಸರ್ಚ್ ಇಂಜಿನ್ ಕ್ರಾಲರ್ಗಳಿಗೆ ಮಾರ್ಗದರ್ಶನ ನೀಡುವುದು ಇದರ ಪ್ರಾಥಮಿಕ ಉದ್ದೇಶವಾಗಿದೆ. ಫೈಲ್ ರೋಬೋಟ್ಸ್ ಎಕ್ಸ್ಕ್ಲೂಷನ್ ಪ್ರೋಟೋಕಾಲ್ ಅನ್ನು ಬಳಸುತ್ತದೆ (REP), ವೆಬ್ ಕ್ರಾಲರ್ಗಳು ಮತ್ತು ಇತರ ವೆಬ್ ರೋಬೋಟ್ಗಳೊಂದಿಗೆ ಸಂವಹನ ನಡೆಸಲು ಪ್ರಮಾಣಿತ ವೆಬ್ಸೈಟ್ಗಳು ಬಳಸುತ್ತವೆ.

REP ಅಧಿಕೃತ ಇಂಟರ್ನೆಟ್ ಮಾನದಂಡವಲ್ಲ ಆದರೆ ಪ್ರಮುಖ ಸರ್ಚ್ ಇಂಜಿನ್ಗಳಿಂದ ವ್ಯಾಪಕವಾಗಿ ಅಂಗೀಕರಿಸಲ್ಪಟ್ಟಿದೆ ಮತ್ತು ಬೆಂಬಲಿತವಾಗಿದೆ. ಗೂಗಲ್, ಬಿಂಗ್ ಮತ್ತು ಯಾಂಡೆಕ್ಸ್ನಂತಹ ಪ್ರಮುಖ ಸರ್ಚ್ ಇಂಜಿನ್ಗಳಿಂದ ದಸ್ತಾವೇಜನ್ನು ಸ್ವೀಕರಿಸಿದ ಮಾನದಂಡಕ್ಕೆ ಹತ್ತಿರದಲ್ಲಿದೆ. ಹೆಚ್ಚಿನ ಮಾಹಿತಿಗಾಗಿ, ಭೇಟಿ ನೀಡಿ Google ನ Robots.txt ವಿಶೇಷಣಗಳು ಸೂಚಿಸಲಾಗುತ್ತದೆ.

SEO ಗೆ Robots.txt ಏಕೆ ನಿರ್ಣಾಯಕವಾಗಿದೆ?

- ನಿಯಂತ್ರಿತ ಕ್ರಾಲಿಂಗ್: Robots.txt ವೆಬ್ಸೈಟ್ ಮಾಲೀಕರಿಗೆ ತಮ್ಮ ಸೈಟ್ನ ನಿರ್ದಿಷ್ಟ ವಿಭಾಗಗಳನ್ನು ಪ್ರವೇಶಿಸದಂತೆ ಸರ್ಚ್ ಇಂಜಿನ್ಗಳನ್ನು ತಡೆಯಲು ಅನುಮತಿಸುತ್ತದೆ. ನಕಲಿ ವಿಷಯ, ಖಾಸಗಿ ಪ್ರದೇಶಗಳು ಅಥವಾ ಸೂಕ್ಷ್ಮ ಮಾಹಿತಿಯನ್ನು ಹೊಂದಿರುವ ವಿಭಾಗಗಳನ್ನು ಹೊರತುಪಡಿಸಿ ಇದು ವಿಶೇಷವಾಗಿ ಉಪಯುಕ್ತವಾಗಿದೆ.

- ಆಪ್ಟಿಮೈಸ್ಡ್ ಕ್ರಾಲ್ ಬಜೆಟ್: ಸರ್ಚ್ ಇಂಜಿನ್ಗಳು ಪ್ರತಿ ವೆಬ್ಸೈಟ್ಗೆ ಕ್ರಾಲ್ ಬಜೆಟ್ ಅನ್ನು ನಿಯೋಜಿಸುತ್ತವೆ, ಹುಡುಕಾಟ ಎಂಜಿನ್ ಬೋಟ್ ಸೈಟ್ನಲ್ಲಿ ಕ್ರಾಲ್ ಮಾಡುವ ಪುಟಗಳ ಸಂಖ್ಯೆ. ಅಪ್ರಸ್ತುತ ಅಥವಾ ಕಡಿಮೆ ಪ್ರಾಮುಖ್ಯತೆಯ ವಿಭಾಗಗಳನ್ನು ಅನುಮತಿಸದಿರುವ ಮೂಲಕ, robots.txt ಈ ಕ್ರಾಲ್ ಬಜೆಟ್ ಅನ್ನು ಆಪ್ಟಿಮೈಜ್ ಮಾಡಲು ಸಹಾಯ ಮಾಡುತ್ತದೆ, ಹೆಚ್ಚು ಮಹತ್ವದ ಪುಟಗಳನ್ನು ಕ್ರಾಲ್ ಮಾಡಲಾಗಿದೆ ಮತ್ತು ಇಂಡೆಕ್ಸ್ ಮಾಡಲಾಗಿದೆ ಎಂದು ಖಚಿತಪಡಿಸುತ್ತದೆ.

- ಸುಧಾರಿತ ವೆಬ್ಸೈಟ್ ಲೋಡ್ ಸಮಯ: ಪ್ರಮುಖವಲ್ಲದ ಸಂಪನ್ಮೂಲಗಳನ್ನು ಪ್ರವೇಶಿಸದಂತೆ ಬಾಟ್ಗಳನ್ನು ತಡೆಯುವ ಮೂಲಕ, robots.txt ಸರ್ವರ್ ಲೋಡ್ ಅನ್ನು ಕಡಿಮೆ ಮಾಡುತ್ತದೆ, ಸೈಟ್ನ ಲೋಡ್ ಸಮಯವನ್ನು ಸಂಭಾವ್ಯವಾಗಿ ಸುಧಾರಿಸುತ್ತದೆ, ಇದು SEO ನಲ್ಲಿ ನಿರ್ಣಾಯಕ ಅಂಶವಾಗಿದೆ.

- ಸಾರ್ವಜನಿಕವಲ್ಲದ ಪುಟಗಳ ಇಂಡೆಕ್ಸಿಂಗ್ ಅನ್ನು ತಡೆಯುವುದು: ಇದು ಸಾರ್ವಜನಿಕವಲ್ಲದ ಪ್ರದೇಶಗಳನ್ನು (ಸ್ಟೇಜಿಂಗ್ ಸೈಟ್ಗಳು ಅಥವಾ ಅಭಿವೃದ್ಧಿ ಪ್ರದೇಶಗಳಂತಹ) ಇಂಡೆಕ್ಸ್ ಮಾಡದಂತೆ ಮತ್ತು ಹುಡುಕಾಟ ಫಲಿತಾಂಶಗಳಲ್ಲಿ ಕಾಣಿಸಿಕೊಳ್ಳಲು ಸಹಾಯ ಮಾಡುತ್ತದೆ.

Robots.txt ಅಗತ್ಯ ಆದೇಶಗಳು ಮತ್ತು ಅವುಗಳ ಉಪಯೋಗಗಳು

- ಅನುಮತಿಸಿ: ಕ್ರಾಲರ್ಗಳು ಸೈಟ್ನ ಯಾವ ಪುಟಗಳು ಅಥವಾ ವಿಭಾಗಗಳನ್ನು ಪ್ರವೇಶಿಸಬೇಕು ಎಂಬುದನ್ನು ನಿರ್ದಿಷ್ಟಪಡಿಸಲು ಈ ನಿರ್ದೇಶನವನ್ನು ಬಳಸಲಾಗುತ್ತದೆ. ಉದಾಹರಣೆಗೆ, ಒಂದು ವೆಬ್ಸೈಟ್ SEO ಗಾಗಿ ನಿರ್ದಿಷ್ಟವಾಗಿ ಸಂಬಂಧಿತ ವಿಭಾಗವನ್ನು ಹೊಂದಿದ್ದರೆ, 'ಅನುಮತಿಸಿ' ಆಜ್ಞೆಯು ಅದು ಕ್ರಾಲ್ ಆಗಿರುವುದನ್ನು ಖಚಿತಪಡಿಸುತ್ತದೆ.

Allow: /public/- ಅನುಮತಿಸಬೇಡಿ: 'Allow' ನ ವಿರುದ್ಧವಾಗಿ, ಈ ಆಜ್ಞೆಯು ವೆಬ್ಸೈಟ್ನ ಕೆಲವು ಭಾಗಗಳನ್ನು ಕ್ರಾಲ್ ಮಾಡದಂತೆ ಸರ್ಚ್ ಎಂಜಿನ್ ಬಾಟ್ಗಳಿಗೆ ಸೂಚನೆ ನೀಡುತ್ತದೆ. ಲಾಗಿನ್ ಪುಟಗಳು ಅಥವಾ ಸ್ಕ್ರಿಪ್ಟ್ ಫೈಲ್ಗಳಂತಹ ಎಸ್ಇಒ ಮೌಲ್ಯವಿಲ್ಲದ ಪುಟಗಳಿಗೆ ಇದು ಉಪಯುಕ್ತವಾಗಿದೆ.

Disallow: /private/- ವೈಲ್ಡ್ಕಾರ್ಡ್ಗಳು: ಪ್ಯಾಟರ್ನ್ ಹೊಂದಾಣಿಕೆಗಾಗಿ ವೈಲ್ಡ್ಕಾರ್ಡ್ಗಳನ್ನು ಬಳಸಲಾಗುತ್ತದೆ. ನಕ್ಷತ್ರ ಚಿಹ್ನೆ (*) ಅಕ್ಷರಗಳ ಯಾವುದೇ ಅನುಕ್ರಮವನ್ನು ಪ್ರತಿನಿಧಿಸುತ್ತದೆ ಮತ್ತು ಡಾಲರ್ ಚಿಹ್ನೆ ($) URL ನ ಅಂತ್ಯವನ್ನು ಸೂಚಿಸುತ್ತದೆ. ವ್ಯಾಪಕ ಶ್ರೇಣಿಯ URL ಗಳನ್ನು ನಿರ್ದಿಷ್ಟಪಡಿಸಲು ಇವು ಉಪಯುಕ್ತವಾಗಿವೆ.

Disallow: /*.pdf$- ಸೈಟ್ಮ್ಯಾಪ್ಗಳು: robots.txt ನಲ್ಲಿ ಸೈಟ್ಮ್ಯಾಪ್ ಸ್ಥಳವನ್ನು ಸೇರಿಸುವುದರಿಂದ ಹುಡುಕಾಟ ಎಂಜಿನ್ಗಳು ಸೈಟ್ನಲ್ಲಿ ಎಲ್ಲಾ ಪ್ರಮುಖ ಪುಟಗಳನ್ನು ಹುಡುಕಲು ಮತ್ತು ಕ್ರಾಲ್ ಮಾಡಲು ಸಹಾಯ ಮಾಡುತ್ತದೆ. ಎಸ್ಇಒಗೆ ಇದು ನಿರ್ಣಾಯಕವಾಗಿದೆ ಏಕೆಂದರೆ ಇದು ಸೈಟ್ನ ವೇಗವಾದ ಮತ್ತು ಹೆಚ್ಚು ಸಂಪೂರ್ಣ ಸೂಚಿಕೆಗೆ ಸಹಾಯ ಮಾಡುತ್ತದೆ.

Sitemap: https://martech.zone/sitemap_index.xmlRobots.txt ಹೆಚ್ಚುವರಿ ಆದೇಶಗಳು ಮತ್ತು ಅವುಗಳ ಉಪಯೋಗಗಳು

- ಬಳಕೆದಾರ-ಏಜೆಂಟ್: ನಿಯಮವು ಯಾವ ಕ್ರಾಲರ್ಗೆ ಅನ್ವಯಿಸುತ್ತದೆ ಎಂಬುದನ್ನು ನಿರ್ದಿಷ್ಟಪಡಿಸಿ. 'ಬಳಕೆದಾರ-ಏಜೆಂಟ್: *' ಎಲ್ಲಾ ಕ್ರಾಲರ್ಗಳಿಗೆ ನಿಯಮವನ್ನು ಅನ್ವಯಿಸುತ್ತದೆ. ಉದಾಹರಣೆ:

User-agent: Googlebot- ನಾಇಂಡೆಕ್ಸ್: ಪ್ರಮಾಣಿತ robots.txt ಪ್ರೋಟೋಕಾಲ್ನ ಭಾಗವಾಗಿಲ್ಲದಿದ್ದರೂ, ಕೆಲವು ಸರ್ಚ್ ಇಂಜಿನ್ಗಳು ಅರ್ಥಮಾಡಿಕೊಳ್ಳುತ್ತವೆ a ನೋಯಿಂಡೆಕ್ಸ್ ನಿರ್ದಿಷ್ಟಪಡಿಸಿದ URL ಅನ್ನು ಸೂಚಿಕೆ ಮಾಡದಿರಲು ಸೂಚನೆಯಂತೆ robots.txt ನಲ್ಲಿ ನಿರ್ದೇಶನ.

Noindex: /non-public-page/- ಕ್ರಾಲ್-ವಿಳಂಬ: ಈ ಆಜ್ಞೆಯು ನಿಮ್ಮ ಸರ್ವರ್ಗೆ ಹಿಟ್ಗಳ ನಡುವೆ ನಿರ್ದಿಷ್ಟ ಸಮಯವನ್ನು ಕಾಯಲು ಕ್ರಾಲರ್ಗಳನ್ನು ಕೇಳುತ್ತದೆ, ಇದು ಸರ್ವರ್ ಲೋಡ್ ಸಮಸ್ಯೆಗಳಿರುವ ಸೈಟ್ಗಳಿಗೆ ಉಪಯುಕ್ತವಾಗಿದೆ.

Crawl-delay: 10ನಿಮ್ಮ Robots.txt ಫೈಲ್ ಅನ್ನು ಹೇಗೆ ಪರೀಕ್ಷಿಸುವುದು

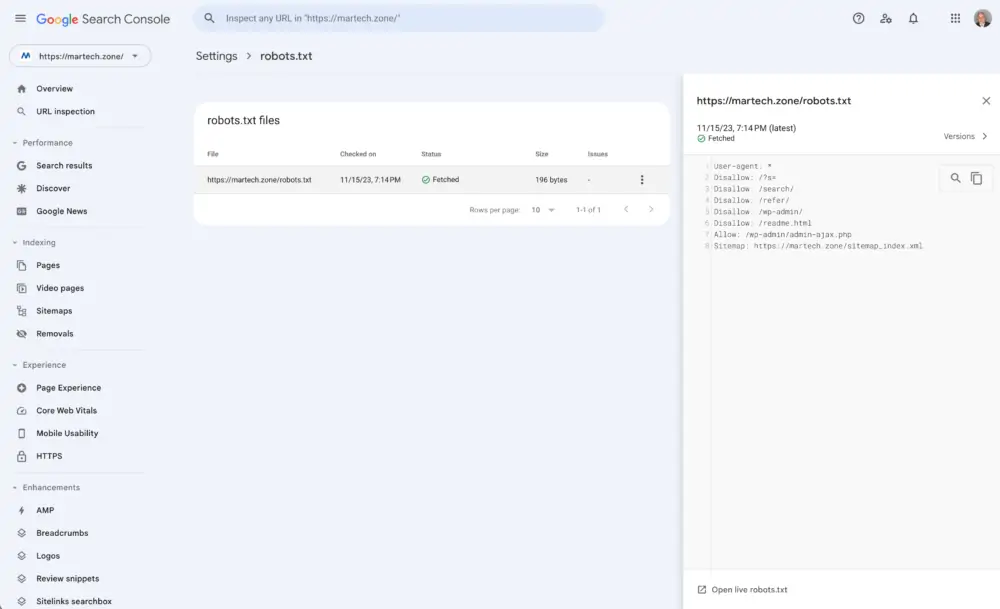

ಅದನ್ನು ಸಮಾಧಿ ಮಾಡಿದರೂ Google ಹುಡುಕಾಟ ಕನ್ಸೋಲ್, ಹುಡುಕಾಟ ಕನ್ಸೋಲ್ robots.txt ಫೈಲ್ ಪರೀಕ್ಷಕವನ್ನು ನೀಡುತ್ತದೆ.

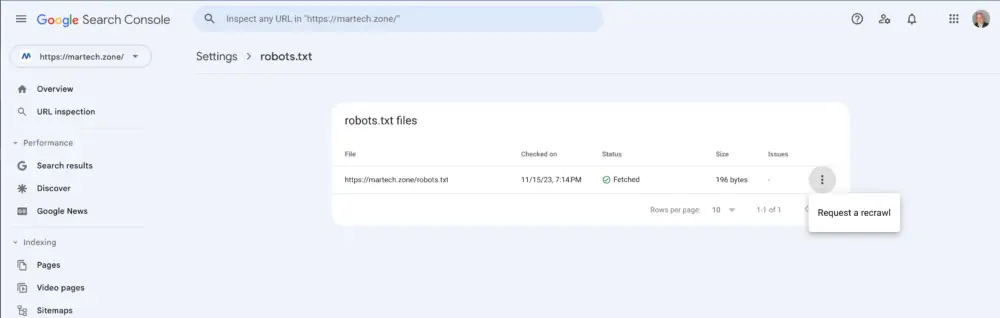

ಬಲಭಾಗದಲ್ಲಿರುವ ಮೂರು ಚುಕ್ಕೆಗಳ ಮೇಲೆ ಕ್ಲಿಕ್ ಮಾಡಿ ಮತ್ತು ಆಯ್ಕೆ ಮಾಡುವ ಮೂಲಕ ನಿಮ್ಮ Robots.txt ಫೈಲ್ ಅನ್ನು ಸಹ ನೀವು ಮರುಸಲ್ಲಿಸಬಹುದಾಗಿದೆ ಮರುಕ್ರಾಲ್ ಮಾಡಲು ವಿನಂತಿಸಿ.

ನಿಮ್ಮ Robots.txt ಫೈಲ್ ಅನ್ನು ಪರೀಕ್ಷಿಸಿ ಅಥವಾ ಮರುಸಲ್ಲಿಸಿ

AI ಬಾಟ್ಗಳನ್ನು ನಿಯಂತ್ರಿಸಲು Robots.txt ಫೈಲ್ ಅನ್ನು ಬಳಸಬಹುದೇ?

ಎಂಬುದನ್ನು ವ್ಯಾಖ್ಯಾನಿಸಲು robots.txt ಫೈಲ್ ಅನ್ನು ಬಳಸಬಹುದು AI ವೆಬ್ ಕ್ರಾಲರ್ಗಳು ಮತ್ತು ಇತರ ಸ್ವಯಂಚಾಲಿತ ಬಾಟ್ಗಳು ಸೇರಿದಂತೆ ಬಾಟ್ಗಳು ನಿಮ್ಮ ಸೈಟ್ನಲ್ಲಿ ವಿಷಯವನ್ನು ಕ್ರಾಲ್ ಮಾಡಬಹುದು ಅಥವಾ ಬಳಸಿಕೊಳ್ಳಬಹುದು. ಫೈಲ್ ಈ ಬಾಟ್ಗಳಿಗೆ ಮಾರ್ಗದರ್ಶನ ನೀಡುತ್ತದೆ, ವೆಬ್ಸೈಟ್ನ ಯಾವ ಭಾಗಗಳನ್ನು ಪ್ರವೇಶಿಸಲು ಅನುಮತಿಸಲಾಗಿದೆ ಅಥವಾ ಅನುಮತಿಸಲಾಗಿದೆ ಎಂಬುದನ್ನು ಸೂಚಿಸುತ್ತದೆ. AI ಬಾಟ್ಗಳ ನಡವಳಿಕೆಯನ್ನು ನಿಯಂತ್ರಿಸುವ robots.txt ನ ಪರಿಣಾಮಕಾರಿತ್ವವು ಹಲವಾರು ಅಂಶಗಳ ಮೇಲೆ ಅವಲಂಬಿತವಾಗಿದೆ:

- ಪ್ರೋಟೋಕಾಲ್ನ ಅನುಸರಣೆ: ಅತ್ಯಂತ ಪ್ರತಿಷ್ಠಿತ ಸರ್ಚ್ ಇಂಜಿನ್ ಕ್ರಾಲರ್ಗಳು ಮತ್ತು ಇತರ ಹಲವು AI ಬಾಟ್ಗಳು ಹೊಂದಿಸಲಾದ ನಿಯಮಗಳನ್ನು ಗೌರವಿಸುತ್ತವೆ

robots.txt. ಆದಾಗ್ಯೂ, ಫೈಲ್ ಜಾರಿಗೊಳಿಸಬಹುದಾದ ನಿರ್ಬಂಧಕ್ಕಿಂತ ಹೆಚ್ಚಿನ ವಿನಂತಿಯಾಗಿದೆ ಎಂಬುದನ್ನು ಗಮನಿಸುವುದು ಮುಖ್ಯವಾಗಿದೆ. ಬಾಟ್ಗಳು ಈ ವಿನಂತಿಗಳನ್ನು ನಿರ್ಲಕ್ಷಿಸಬಹುದು, ವಿಶೇಷವಾಗಿ ಕಡಿಮೆ ಸೂಕ್ಷ್ಮ ಘಟಕಗಳಿಂದ ನಿರ್ವಹಿಸಲ್ಪಡುತ್ತವೆ. - ಸೂಚನೆಗಳ ನಿರ್ದಿಷ್ಟತೆ: ವಿಭಿನ್ನ ಬಾಟ್ಗಳಿಗೆ ನೀವು ವಿಭಿನ್ನ ಸೂಚನೆಗಳನ್ನು ನಿರ್ದಿಷ್ಟಪಡಿಸಬಹುದು. ಉದಾಹರಣೆಗೆ, ಇತರರಿಗೆ ಅನುಮತಿಸದಿರುವಾಗ ನಿಮ್ಮ ಸೈಟ್ ಅನ್ನು ಕ್ರಾಲ್ ಮಾಡಲು ನಿರ್ದಿಷ್ಟ AI ಬಾಟ್ಗಳನ್ನು ನೀವು ಅನುಮತಿಸಬಹುದು. ಇದನ್ನು ಬಳಸಿ ಮಾಡಲಾಗುತ್ತದೆ

User-agentನಲ್ಲಿ ನಿರ್ದೇಶನrobots.txtಮೇಲಿನ ಫೈಲ್ ಉದಾಹರಣೆ. ಉದಾಹರಣೆಗೆ,User-agent: GooglebotGoogle ನ ಕ್ರಾಲರ್ಗೆ ಸೂಚನೆಗಳನ್ನು ನಿರ್ದಿಷ್ಟಪಡಿಸುತ್ತದೆUser-agent: *ಎಲ್ಲಾ ಬಾಟ್ಗಳಿಗೆ ಅನ್ವಯಿಸುತ್ತದೆ. - ಇತಿಮಿತಿಗಳು: ಆದರೆ

robots.txtನಿರ್ದಿಷ್ಟಪಡಿಸಿದ ವಿಷಯವನ್ನು ಕ್ರಾಲ್ ಮಾಡುವುದರಿಂದ ಬಾಟ್ಗಳನ್ನು ತಡೆಯಬಹುದು; ಅವರು ಈಗಾಗಲೇ ತಿಳಿದಿದ್ದರೆ ಅದು ಅವರಿಂದ ವಿಷಯವನ್ನು ಮರೆಮಾಡುವುದಿಲ್ಲ URL ಅನ್ನು. ಹೆಚ್ಚುವರಿಯಾಗಿ, ವಿಷಯವನ್ನು ಕ್ರಾಲ್ ಮಾಡಿದ ನಂತರ ಅದರ ಬಳಕೆಯನ್ನು ನಿರ್ಬಂಧಿಸಲು ಇದು ಯಾವುದೇ ವಿಧಾನವನ್ನು ಒದಗಿಸುವುದಿಲ್ಲ. ವಿಷಯ ರಕ್ಷಣೆ ಅಥವಾ ನಿರ್ದಿಷ್ಟ ಬಳಕೆಯ ನಿರ್ಬಂಧಗಳು ಅಗತ್ಯವಿದ್ದರೆ, ಪಾಸ್ವರ್ಡ್ ರಕ್ಷಣೆ ಅಥವಾ ಹೆಚ್ಚು ಅತ್ಯಾಧುನಿಕ ಪ್ರವೇಶ ನಿಯಂತ್ರಣ ಕಾರ್ಯವಿಧಾನಗಳಂತಹ ಇತರ ವಿಧಾನಗಳು ಅಗತ್ಯವಾಗಬಹುದು. - ಬಾಟ್ಗಳ ವಿಧಗಳು: ಎಲ್ಲಾ AI ಬಾಟ್ಗಳು ಸರ್ಚ್ ಇಂಜಿನ್ಗಳಿಗೆ ಸಂಬಂಧಿಸಿಲ್ಲ. ವಿವಿಧ ಬಾಟ್ಗಳನ್ನು ವಿವಿಧ ಉದ್ದೇಶಗಳಿಗಾಗಿ ಬಳಸಲಾಗುತ್ತದೆ (ಉದಾ, ಡೇಟಾ ಒಟ್ಟುಗೂಡಿಸುವಿಕೆ, ವಿಶ್ಲೇಷಣೆಗಳು, ವಿಷಯ ಸ್ಕ್ರ್ಯಾಪಿಂಗ್). robots.txt ಫೈಲ್ ಅನ್ನು ಈ ವಿಭಿನ್ನ ರೀತಿಯ ಬಾಟ್ಗಳಿಗೆ ಪ್ರವೇಶವನ್ನು ನಿರ್ವಹಿಸಲು ಸಹ ಬಳಸಬಹುದು, ಅವುಗಳು REP ಗೆ ಬದ್ಧವಾಗಿರುವವರೆಗೆ.

ನಮ್ಮ robots.txt AI ಬಾಟ್ಗಳಿಂದ ಸೈಟ್ ವಿಷಯದ ಕ್ರಾಲ್ ಮತ್ತು ಬಳಕೆಗೆ ಸಂಬಂಧಿಸಿದಂತೆ ನಿಮ್ಮ ಆದ್ಯತೆಗಳನ್ನು ಸಂಕೇತಿಸಲು ಫೈಲ್ ಪರಿಣಾಮಕಾರಿ ಸಾಧನವಾಗಿದೆ. ಆದಾಗ್ಯೂ, ಅದರ ಸಾಮರ್ಥ್ಯಗಳು ಕಟ್ಟುನಿಟ್ಟಾದ ಪ್ರವೇಶ ನಿಯಂತ್ರಣವನ್ನು ಜಾರಿಗೊಳಿಸುವ ಬದಲು ಮಾರ್ಗಸೂಚಿಗಳನ್ನು ಒದಗಿಸುವುದಕ್ಕೆ ಸೀಮಿತವಾಗಿವೆ ಮತ್ತು ಅದರ ಪರಿಣಾಮಕಾರಿತ್ವವು ರೋಬೋಟ್ಗಳ ಹೊರಗಿಡುವ ಪ್ರೋಟೋಕಾಲ್ನೊಂದಿಗೆ ಬಾಟ್ಗಳ ಅನುಸರಣೆಯನ್ನು ಅವಲಂಬಿಸಿರುತ್ತದೆ.

robots.txt ಫೈಲ್ ಎಸ್ಇಒ ಆರ್ಸೆನಲ್ನಲ್ಲಿ ಸಣ್ಣ ಆದರೆ ಪ್ರಬಲ ಸಾಧನವಾಗಿದೆ. ಸರಿಯಾಗಿ ಬಳಸಿದಾಗ ಅದು ವೆಬ್ಸೈಟ್ನ ಗೋಚರತೆ ಮತ್ತು ಹುಡುಕಾಟ ಎಂಜಿನ್ ಕಾರ್ಯಕ್ಷಮತೆಯನ್ನು ಗಮನಾರ್ಹವಾಗಿ ಪ್ರಭಾವಿಸುತ್ತದೆ. ಸೈಟ್ನ ಯಾವ ಭಾಗಗಳನ್ನು ಕ್ರಾಲ್ ಮಾಡಲಾಗಿದೆ ಮತ್ತು ಇಂಡೆಕ್ಸ್ ಮಾಡಲಾಗಿದೆ ಎಂಬುದನ್ನು ನಿಯಂತ್ರಿಸುವ ಮೂಲಕ, ವೆಬ್ಮಾಸ್ಟರ್ಗಳು ತಮ್ಮ ಅತ್ಯಂತ ಮೌಲ್ಯಯುತವಾದ ವಿಷಯವನ್ನು ಹೈಲೈಟ್ ಮಾಡುವುದನ್ನು ಖಚಿತಪಡಿಸಿಕೊಳ್ಳಬಹುದು, ಅವರ SEO ಪ್ರಯತ್ನಗಳು ಮತ್ತು ವೆಬ್ಸೈಟ್ ಕಾರ್ಯಕ್ಷಮತೆಯನ್ನು ಸುಧಾರಿಸಬಹುದು.